أعلنت شركة جوجل تحديثًا جديدًا لأداة “البحث العميق Deep Research” في مساعدها الذكي Gemini، لتتيح للمستخدمين تحويل تقاريرهم البحثية إلى محتوى بصري تفاعلي يضم الرسوم البيانية والصور. وتأتي هذه الخطوة كجزء من جهود جوجل لتعزيز قدرة ذكائها الاصطناعي على تحليل البيانات وتقديم نتائج تفاعلية.

وتتيح أداة Deep Research للمستخدمين إجراء تحليلات شاملة للويب باستخدام الذكاء الاصطناعي، كما يمكنها الاستفادة من البيانات الموجودة في Gmail ودرايف وسجل المحادثات في Google Chat لتوفير سياق إضافي للتقارير البحثية.

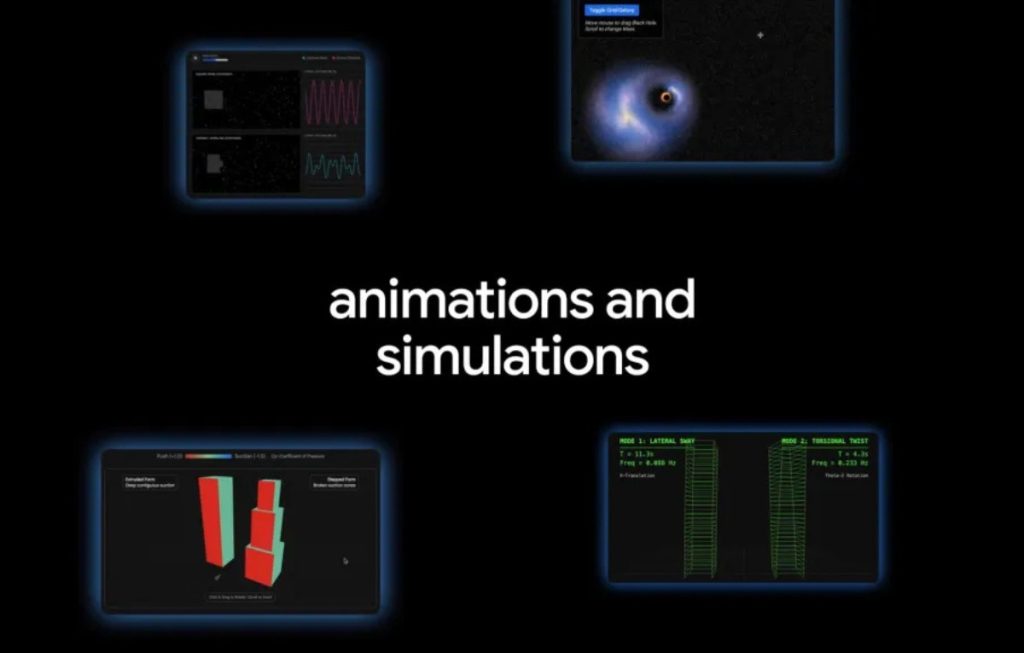

وبعد إنشاء التقرير النصي، أصبح بإمكان الأداة الآن تحويل النتائج مباشرةً إلى تقارير بصرية تفاعلية، تضم الرسوم التوضيحية والجداول بطريقة تشبه ميزة الواجهة التوليدية (Generative UI) المُضافة سابقًا إلى وضع AI Mode في بحث جوجل.

ووفقًا لما نشرته جوجل في مدونتها، فإن الأداة أصبحت قادرة على توضيح النتائج تلقائيًا، سواءً كانت تخص تخصيص ميزانيات التسويق أو استكشاف نظريات علمية معقدة. ويمكن للمستخدمين التفاعل مع نموذج محاكاة ديناميكي داخل التقرير، وعرض النتائج بناءً على متغيرات مختلفة، بدلًا من الاقتصار على قراءة النصوص فقط.

وتتخذ الأداة قرارات ذكية بشأن الرسوم والعناصر البصرية التي يجب إنشاؤها وفقًا لنتائج البحث، مثل بناء جدول دوري تفاعلي في حال كان التقرير عن الكيمياء، أو عرض بيانات كثيفة على شكل مخططات خطية أو أعمدة. كما يمكن للأداة إنشاء المخططات والرسوم التخطيطية المعقدة بنحو ديناميكي في الوقت الفعلي، بما يتوافق مع طلب البحث المقدم.

ويمكن للمستخدمين تجربة ميزة “البحث العميق Deep Research” عبر تطبيق Gemini عبر الويب، من خلال اختيار الأداة من قائمة الأدوات وإدخال طلب البحث، لتوليد تقرير بحثي مُخصص يضم الرسوم البيانية والعناصر البصرية المدعومة بالذكاء الاصطناعي.

وتجدر الإشارة إلى أن هذه الميزة التفاعلية حاليًا متاحة فقط لمشتركي خطة Google AI Ultra التي تصل تكلفتها إلى 250 دولارًا شهريًا، على أن تتوسع لاحقًا لتشمل عددًا أكبر من مستخدمي Gemini.

تابعنا